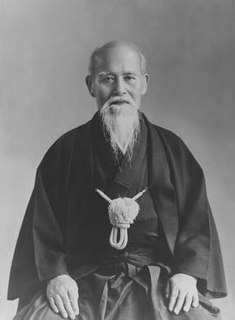

Ein Zitat von Yagyu Munenori

Es ist voreingenommen zu glauben, dass die Kunst des Krieges nur dazu dient, Menschen zu töten. Es geht nicht darum, Menschen zu töten, sondern darum, das Böse zu töten. Es ist eine Strategie, vielen Menschen Leben zu geben, indem man das Böse einer Person tötet.

Themen zitieren

Verwandte Zitate

Kira ist böse ... Das lässt sich nicht leugnen ... Aber in letzter Zeit fange ich an, es mir eher so vorzustellen ... Das wahre Böse ist die Macht, Menschen zu töten. Jemand, der diese Macht besitzt, ist verflucht. Egal, wie man es einsetzt, alles, was man durch das Töten von Menschen erhält, kann niemals wahres Glück bringen.

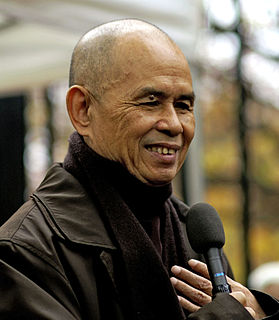

Ich bin entschlossen, nicht zu töten, andere nicht töten zu lassen und keine Tötungshandlung in der Welt, in meinem Denken und in meiner Lebensweise zu dulden. Wir können keine Tötungshandlungen unterstützen; Kein Töten kann gerechtfertigt werden. Aber nicht zu töten ist nicht genug ... Wenn Sie in Ihrem Denken zulassen, dass das Töten weitergeht, verstoßen Sie auch gegen dieses Gebot. Wir müssen entschlossen sein, das Töten nicht zu dulden, nicht einmal in Gedanken.

Lass mich dir von Schwäche erzählen! Die Starken zu töten, um seine Stärke zu beweisen, ist törichte Schwäche. Narren zu töten ist eine leichte Schwäche. Die Schwachen zu töten ist böse Schwäche. Seine Ziele erreichen, ohne zu töten, seinen Verstand zu beherrschen, wenn man töten will – das ist Stärke!

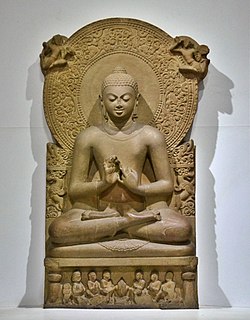

Was ist böse? Töten ist böse, Lügen ist böse, Verleumdung ist böse, Missbrauch ist böse, Klatsch ist böse, Neid ist böse, Hass ist böse, an falschen Lehren festzuhalten ist böse; all diese Dinge sind böse. Und was ist die Wurzel des Bösen? Verlangen ist die Wurzel des Bösen, Illusion ist die Wurzel des Bösen.

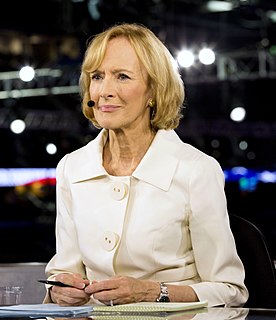

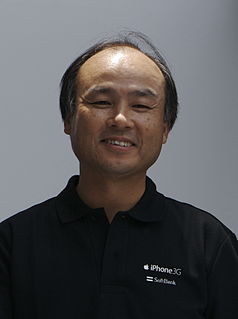

Ich denke, es gibt eine grundlegende moralische Frage darüber, ob es richtig ist, dass eine Maschine beschließt, einen Menschen zu töten. Es ist schon schlimm genug, dass Menschen beschließen, Menschen zu töten, aber zumindest haben sie vielleicht ein moralisches Argument dafür, dass sie es letztendlich tun, um ihre Familien zu verteidigen oder ein größeres Übel zu verhindern.

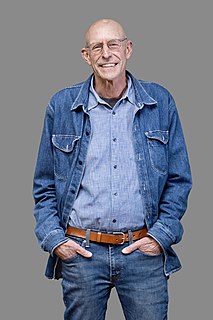

Das ist für viele Menschen das Anstößigste an der Jagd – für manche sogar das Ekelhafteste: dass sie uns nicht nur zum Töten ermutigt oder erlaubt, sondern auch eine gewisse Freude am Töten zu empfinden. Es ist nicht so, dass der Rest von uns nicht damit einverstanden wäre, jedes Jahr zig Millionen Tiere zu töten. Doch aus irgendeinem Grund fühlen wir uns wohler mit der maschinellen Tötung, die in der industriellen Landwirtschaft unauffällig und ohne Emotionen praktiziert wird.

Ich denke, dass wir alle wissen, was das Böse ist. Wir haben ein Gespür dafür, was böse ist, und ganz gewiss ist es böse, unschuldige Menschen zu töten. Wir sind uns weniger sicher, was gut ist. Es gibt eine Art „gut“, „gut genug“, „könnte besser sein“ – aber „absolut gut“ ist etwas schwieriger zu definieren.

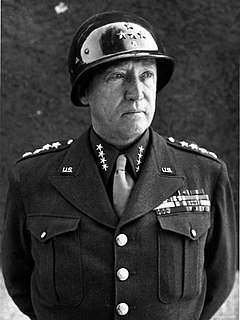

Krieg ist nicht schlicht und einfach Gewalt und Töten; Krieg ist kontrollierte Gewalt mit einem bestimmten Zweck. Der Zweck des Krieges besteht darin, die Entscheidungen Ihrer Regierung mit Gewalt zu unterstützen. Der Zweck besteht nie darin, den Feind zu töten, nur um ihn zu töten, sondern darin, ihn dazu zu bringen, das zu tun, was Sie von ihm erwarten. Nicht töten... sondern kontrollierte und gezielte Gewalt.

Damals waren wir sauer auf Muammar Gaddafi, was dazu führte, dass wir ganz Libyen bombardierten und eine Menge Menschen töteten, ihn aber nicht. Dann steht Ronald Reagan auf und sagt, wir versuchen nicht, ihn zu töten, wir werfen nur Bomben ab. Sie können so viele Libyer töten, wie Sie wollen, aber legal dürfen Sie nicht versuchen, den Anführer zu töten.